Мы в SocialJet любим и умеем работать с алгоритмами соцсетей. Однако мы не закрываем глаза на явные недостатки дистрибуции и политики модерации в Facebook, Twitter, VK и Instagram.

Распространенная логическая ошибка: любить можно только идеальный объект. Несовершенные вещи недостойны любви, недостатки любимого объекта нужно скрывать, не замечать, рационализировать — так считают дети и гностики. Мы думаем иначе.

Мы благодарны всем журналистам, активистам, политикам, которые имеют достаточно смелости, чтобы указывать на эти недостатки. Только так можно исправить недостатки соцсетей и сделать их лучше. И мы надеемся, что первые значительные изменения в регуляторной политике совсем скоро превратят соцсети в безопасные и более совершенные пространства для всех.

В данной статье мы рассмотрим больную тему:

Как соцсети модерируют контент?

Быстрый ответ — никак. До недавнего времени модерация в соцсетях осуществлялась плохо и зачастую случайно.

Рассмотрим как Facebook, Twitter, Telegram и другие моделируют и доставляют контент. Триггеры: экстремизм, алгоритмы, шок-контент, дистрибуция, модерация.

Хорошие модераторы дороги, поэтому соцсеть с капитализацией в 770 миллиардов USD обходится лучшими филиппинскимимодераторами, самыми способными индусами. Независимая и полноценная модерация контента в Facebook появилась только в 2020 году, а работать она начала с января 2021 года (здесь можно посмотреть на первые результаты работы комиссии Facebook Oversight Board, FOB).

Состав Facebook Oversight Board в конце марта

По штату FOB состоит из 40 сотрудников, сейчас работают только 19 — на момент публикации статьи в FOB нет представителей Китая, России, Германии, средней Азии (из Восточной Европы представлена только Венгрия). Каждую жалобу рассматривает 5 членов комиссии, их решение становится окончательным после одобрения большинством голосов всех члены комиссии.

Сейчас FOB выступает в роли убер-модератора — рассматривает апелляции на восстановление заблокированного аккаунта или спорного контента, который не пропустили в ленту обычные модераторы. Со временем комиссия получит больше полномочий относительно постов, комментариев, лайков. Вопросы алгоритмов и рекламного контента, харассмента и фейковых новостей в закрытых группах не входят и не будут входить в компетенцию FOB.

Кроме FOB, частично вопросы модерации и дистрибуции в соцсетях закрывают некоторые журналисты. Какой контент должны видеть пользователи соцсетей решают внешние модераторы из либеральных изданий:

- журналисты раздела технологий New York Times: Mike Isaac, Sheera Frenkel, Kevin Roose.

- медиа журналисты редакции CNN: Brian Stelter, Oliver Darcy.

- “Отряд по борьбе с дезинформацией” NBC: Brandy Zadrozny, Ben Collins.

Эти и другие журналисты изданий The Guardian, ProPublica, MSNBC оказывают давление на соцсети, на Google, YouTube, Apple. Если раньше соцсети не хотели ограничивать свободу слова, то теперь их заставили ввести строгую цензуру в ответ на любое мнение, которое не нравится определенным журналистам.

Не всем журналистам — лишь тем, которые главной целью своей деятельности считают уничтожение репутации, карьеры отдельных людей, компаний. Тем журналистам, которые доносят на своих коллег и убивают их подкасты. Тем журналистам, которые подслушивают инвесторов в голосовых чатах Clubhouse в надежде поймать их на n-слове или беспочвенно обвинить их в мизогинии, антисемитизме, расизме, элитизме и других нехороших словах. Тем журналистам, которые призывают Apple удалять подкасты, блокировать 4Chan, Reddit, Telegram, Signal, Parler, потому что они (журналисты) пока не научились подслушивать разговоры пользователей в этих соцсетях.

К этим журналистам присоединяются некоторые политики, которые готовы возглавить охоту на ведьм, но их инициативу перехватывают организации, правительства отдельных стран: в 2021 году все будут говорить соцсетям, как нужно модерировать контент.

Такая сложная система влияний делает модерацию контента в соцсетях почти всегда непредсказуемой, случайной, зависимой от погоды и последних апдейтов sjw-повестки в головах некоторых журналистов. Основной стабильной гарантией безопасности жизни контента в соцсетях служит его способность создавать прибавочную стоимость для соцсетей — единственная твердая метрика контента. Если ваш контент генерирует клики, вовлечение, прибыль для соцсетей, то, скорее всего, вас модерировать не будут. Наоборот, соцсети вам предложат специальные условия, как для премиум партнера, и закроют глаза на явные нарушения правил, на нервное потрескивание клавиатуры под пальцами фрустрированных журналистов с фиолетовой прической и активной гражданской позицией.

Дальше можно не читать. В предыдущем абзаце мы передали суть пары миллионов человеко-часов, которые ежегодно тратятся на написание подобных статей. Однако, если хотите узнать о соцсетях нечто совершенно иное, продолжайте читать. Будет весело и страшно.

Содержание

- модерация контента в Facebook, Instagram

- модерация контента в Twitter

- альтернатива: Parler, Mastodon

- модерация контента в Telegram, OK, VK

Сейчас мы расскажем, как соцсети решают, что показывать в своих лентах, какую рекламу можно продавать и покупать. Facebook и Twitter как самые развитые социальные сети получат непропорционально большую долю внимания. Потому что вопросов к ним у обычных пользователей, медиа журналистов и правительств накопилось больше всего.

Остальные соцсети получат меньше нашего внимания, потому что они, как правило, повторяют каждое движение алгоритма Facebook. YouTube, Snapchat, Pinterest не рассматриваем — уж очень типичные проблемы модерации можно встретить в этих соцсетях.

Необходимое предупреждение: мы не нарушаем правила соцсетей и вам не советуем. По роду своей деятельности мы в платформе дистрибуции контента SocialJet постоянно работаем с большими объемами рекламы в соцсетях и знаем немного больше, чем говорится в правилах. Об этом сегодня и поговорим.

Модерация контента в Facebook

«Чувствуешь запах? Это Facebook, сынок. Больше ничто в мире не пахнет так… Я люблю запах свежего поста в ленте поутру. Однажды мы таргетили политическую группу Donald Trump Is Our President в Facebook. Рекламной каруселью из 6 слайдов, двенадцать часов подряд. И когда всё закончилось, я зашел в ту группу. Там уже никого не было, даже ни одного вонючего трупа. Но запах! Вся группа была им пропитана. Это был запах… победы!»

Апокалипсис сегодня

Большая часть контента в Facebook не доходит до конечного получателя. Это справедливо для умной ленты в большом Фейсбуке — закрытые группы в этой соцсети живут по другим правилам.

Конкуренция: сотни тысяч продюсеров, журналистов, дизайнеров создают классный контент на Facebook. Любой пост с качеством выше среднего не проходит сквозь жернова конкуренции — побеждает самый сильный контент. Такова особенность этой соцсети, но эту особенность легко обойти попаданием в информационные пузыри и рекомендации. Какой контент чаще попадает в рекомендации? Сейчас увидим.

Алгоритмический редактор ленты в Facebook умеет показывать большому количеству пользователей только те посты, которые:

- платные

- недавно опубликованы

- опубликованы с аккаунта, у которого есть история вирусных постов

- могут быть интересны отдельному сегменту аудитории — люди со схожими интересами, реакциями на посты

- вызывают наибольший отклик у отдельного сегмента аудитории

- провоцируют пользователей на примитивную реакцию: смогут ли они одним словом выразить эмоциональное вовлечение к посту? Заставит ли одна картинка, одно видео пользователей дружно сказать «вау!», «лол!»

- опубликованы с аккаунта, на который подписаны пользователи

Плюс еще где-то 842 параметра в тихий солнечный день. Когда в небе перепутанные перистые облака (cirrus intortus), алгоритм Facebook ранжирует вероятность показа уже по условно 965 параметрам.

Разработчики соцсети предельно размыто описывают механизм ранжирования контента, не называют модели используемого машинного обучения, но говорят всего о трех проходках на выборке из 1000 постов: алгоритм отбирает 500 наиболее релевантных постов при первой проходке, а на втором этапе присваивает этим 500 постам оценки, и наконец на третьем этапе определяет контекст постов для пользователя. Если после трех этапов отбора алгоритм уверен, что формат и контекст поста совпадают с интересами пользователя, то он пропускает пост в ленту.

Предельно размыто и без конкретики: по тщательному сокрытию конкретных моделей и методов машинного обучения внутри алгоритма Facebook, по примитивному описанию работы алгоритма можно только догадываться, что там работают несложные дуэты из логистических регрессий и наивного Байеса.

Создатели алгоритма усложняют и добавляют все больше переменных, чтобы любознательным пользователям труднее было обмануть Facebook постами типа «10 пород котов, которые любят %бренд_корма_для_кошек%».

Большинство этих параметров — шум, не сигнал. Следовать им, пытаться угадать их изменения бесполезно. Единственное, на что обращает внимание Facebook — это вовлечение и реакции. Алгоритмический редактор ленты хорошо фильтрует контент со слабым потенциалом вовлечения: пользователи не видят посты, в которых алгоритм не уверен.

Алгоритм всегда покажет пользователям то, что они хотят увидеть, а не то, что им нужно увидеть.

С точки зрения журналистских стандартов, алгоритмический редактор ленты Facebook — это плохой редактор. Его решения примитивны, непрозрачны, случайны, плохо отвечают здравому смыслу нормального человека. Алгоритм не различает факты и мнения, не умеет отсеивать предрассудки, разжигание ненависти, конспирологию, деструктивные культы, призывы к физической расправе.

То есть. Даже стандарты журналистики, этой часто пристрастной и субъективной профессии, оказываются недосягаемыми для алгоритма Facebook. Это проблема? Да, но у этой проблемы есть элегантное решение.

Показы, лайки, охваты в Facebook давно стали единственным важным драйвером трафика для локальных и глобальных СМИ. Более того, отдельные издания (британский The Telegraph) начинают эксперименты с привязкой части зарплаты журналистов к метрикам популярности их статей (охваты, клики, подписчики) в социальных сетях. Пока такая практика находится на стадии планирования, однако журналисты уже начинают переживать, что им придется больше писать про Меган Маркл, COVID-19, политические скандалы, и меньше заниматься интересными и важными репортажами, расследованиями.

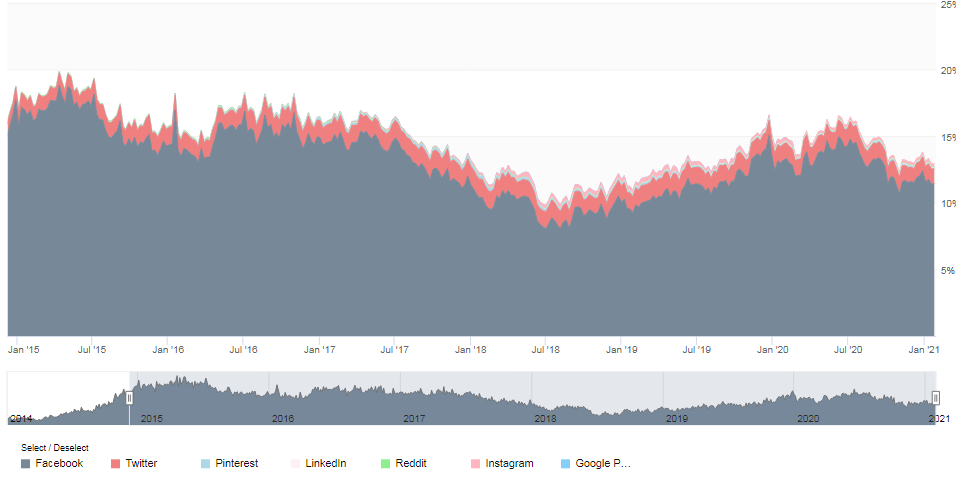

Начиная с 2015 года Facebook генерирует солидные потоки трафика для СМИ: в 10-17 раз больше остальных соцсетей вместе взятых. Twitter на втором месте с жалкими 1,3% трафика для СМИ.

Таким образом, с помощью информационных пузырей и модерации контента, алгоритм обучил СМИ новому условному рефлексу: «вовлечение превыше всего»=трафик. В битве за реакции пользователей некоторые представители СМИ начали писать так, что роботы Google/Facebook зачитываются. Во время написания этой статьи нам даже приходилось бить нашего копирайтера по рукам: заставляли ее удалять из текста эмодзи, шок контент, вирусные обещания, кликбейт и спекулятивные призывы к действию. Сложно поверить насколько прочно внедряется в умы опытных специалистов привычка думать и писать под диктовку алгоритма Facebook.

А теперь рассмотрим правила модерации контента Facebook на практике

Стандарты сообщества однозначно защищают права и свободы всех пользователей. Противоречивый, сомнительный контент улетает в бан, даже не проходит алгоритмических фильтров модерации. Или остается скрытым в ленте, если он может быть полезен для спецслужб. Это знакомо всем, чьи рекламные аккаунты без причины блокировались, а попытки апеллировать к модераторам приводили к невнятным отговоркам и/или продолжению бана на 30-60-90 дней.

Но веселее глядим, товарищи. Контент, который способен производить килотонны ненависти, угрожать жизни и безопасности реальных людей можно постить на Facebook при одном условии: такой контент должен быть вирусным, генерировать вовлеченность и прибыль для Facebook, давать возможность заработать крупным СМИ, или облегчать работу сотрудникам внешней разведки.

Например, все проблемы с модерацией контента растворяются как только ваш пост:

1) размещается через рекламный кабинет

2) способствует росту продаж косметических средств в промышленных масштабах

3) повышает конкуренцию и стоимость рекламы для косметических брендов

Социальная реклама Nike, Dove — если о вашей рекламе говорят говорящие головы в СМИ и в телевизоре, если миллионы людей готовы перейти к физическому устранению несогласных, то Facebook простит вам любое нарушение правил.

Потому что, если вы поможете Facebook заработать больше, то к вам будут применяться совсем другие правила. Особенно важен правильный тайминг — со своими креативными рекламными кампаниями нужно выходить на рынок в год выборов. В 2016 и в 2020 году Facebook и часть крупных СМИ заработали на 8-13% больше, чем в обычные годы:

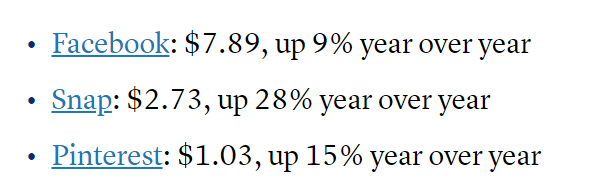

Соцсеть получает $7.89 USD прибыли в год на одном пользователе. При годовой выручке в 26-28 миллиардов, это примерно 3 миллиарда сверх ожиданий и прогнозов аналитиков. Как думаете, захочет ли Facebook показывать слабые посты, которые плохо конвертят и продают? Особенно в год выборов, когда вовлечение аудитории ощутимо возрастает?

Трамп это лучшее, что было в жизни Facebook и крупных изданий. Это самый удачный кейс, который принес этой соцсети 2-3 миллиарда долларов сверху в двух отчетных периодах прошлого года: +22% прибыли в третьем квартале 2020 и +33% в четвертом квартале. Главным СМИ война с Трампом дарила по несколько сотен миллионов долларов каждый год и +8-11% годовой выручки в год выборов. Именно поэтому Facebook долго еще будет пугать своих пользователей чучелом этого политика, несмотря на все заверения в обратном.

Но Facebook и New York Times вам об этом не расскажут. Для обычных людей найдутся милые, нейтральные примеры успеха — например, автоматизация вовлечения в 4 раза с помощью платформ контент менеджмента. Но если знать, куда смотреть, то алгоритмы Facebook не так уж сложны, правда?

Пример оптимизированной под алгоритмы Facebook рекламы:

Здоровье — это то, что мы называем здоровьем.

Вирусная реклама от 1 января 2021 года. Тайминг безупречный — в начале года в штатах решалась судьба президентских выборов, все люди обновляли ленту Facebook по 200 раз в сутки. Реклама Космо создавалась под Facebook, удачно. Целых 7-10 дней соцсети тихо гудели недовольным гулом: блогеры записывали свое мнение о безответственной рекламе ожирения; физически активные пользователи громко кричали от негодования; любители поесть ночью временно перестали чувствовать вину за свои полуночные набеги на холодильник. Ведущие в телевизоре звонили врачам и диетологам с просьбой устроить прожарку этой рекламе. Идеальный кейс.

Татуировка на правой руке модели — «Кому принадлежит мир? Тебе». Милая пасхалка от спонсоров рекламы. «Esse quam videri» — «быть, а не казаться» — девиз многочисленных учебных заведений. И студенческих объединений Lambda Kappa Sigma (фарма), Phi Beta (искусство), Phi Gamma Nu (бизнес). Все они передают вам привет и считают, что вы должны поправиться немедленно. Ибо это и есть здоровье, на самом деле.

Разберем детали. Реклама Космо намеренно провоцирует:

— полных людей: «я буду защищать свое право оставаться полной, потому что так сказал Космополитен»,

— нормальных людей: «я что, зря похудела?»,

— экспертов по фитнесу, питанию, стилю: «сейчас я им всем расскажу, что такое здоровое тело!»

— skinny fat офисных сотрудников, которые ежедневно колеблются между желанием похудеть и желанием съесть булочку на ночь, разрываются между колючим мнением экспертов и мягким поглаживанием Космополитен.

Как видим, соцсетям и кликбейтным помойкам нравится такой контент, они готовы копипастить скрины комментариев и называть это журналистикой. Facebook, Twitter подняли волну провокаций, лайфстайл- и фуд-блогеры на YouTube подхватили новый инфоповод, СМИ и ТВ каналы получили очередной сюжет для дневного слота в эфире. Шлейф бесплатной рекламы и вирусного пиара растянулся на пару недель и несколько миллионов долларов.

Это прямые результаты рекламы в моменте. Косвенно получаем отложенные во времени результаты:

- кондитерские и пиццерии получат больше заказов;

- целевая аудитория поляризуется, увеличится кратно — сегменты «за» и «против» реагируют на раздражитель одинаково (привычек своих не меняют, покупают больше, едят пиццу или голодают с одинаковым остервенением);

- средства для похудения (кремы, пластыри, массажеры) на Amazon получат кратковременный приток новых клиентов, которым можно допродавать косметику и коврики для йоги;

- контент-менеджеры добавят в свои контент-планы новую тему «здоровое ожирение 101: подробный мануал»;

- поисковые системы получат новые ключевые запросы «как поправиться и быть здоровым одновременно»;

- модные бутики закажут китайским/пакистанским потогонкам большие партии купальников размера XL;

- маркетологи срочно начнут продавать обучающие курсы по работе с модным хештегами в Instagram/Pinterest типа #fitbutfat #thickfit #slimthiccc #thiccc #thiccc #thiccc+;

- дестигматизация ожирения рождает новую тему для разговоров на пляже;

- продажи алкоголя растут как среди мужчин, так и среди женщин.

Реклама в Космо помогает Google и Facebook открывать новые ниши трафика, под которые будут создаваться продукты, услуги, сайты, рекламные кампании. Новая ниша + реклама + клики = профит. Win-win для всех. И даже для полных людей, которые будут считать себя здоровыми, перестанут тратить деньги на бесполезные диеты и закажут себе двойную пиццу.

Запомните: генерирование прибыли только для себя противоречит стандартам сообщества Facebook. Любой контент должен генерировать прибыль и вовлечение для соцсети, повышать конкуренцию за рекламный инвентарь для всех представителей ниши — только тогда модераторы отвернутся на минутку и пропустят любой пост.

Промежуточный вывод по работе с Facebook

- всегда регистрируйтесь в Facebook под своим реальным именем, указывайте свой город и место работы, загружайте свои фотографии и фото своих друзей. Facebook хочет знать вас в лицо, за доступ к вашим данным он прощает многое

- модерация контента в этой соцсети не так страшна, как ее принято считать. Провоцируйте, но не жадничайте: и для вас модерации не будет

- повышайте вовлечение с помощью манипуляций негативными эмоциями пользователей. Разжигайте ненависть только если это поможет вам и Facebook заработать пару долларов или собрать больше данных о вашей аудитории. Старайтесь попасть в актуальный информационный пузырь с живой аудиторией или формируйте свой пузырь

Модерация контента в Instagram

Здесь все просто. Instagram не изобретает ничего нового, пользуется алгоритмами Facebook, делится собранными данными. Акцент в этой соцсети смещается на некорректные сравнения между обычными людьми и генетическими фриками на зарплате у брендов (инфлюенсерами) с целью повышения продаж.

Нет, это не фотошоп. Это икона Instagram-инфлюенсеров, Michelle Lewin на следующий день после Нового Года (источник).

Вместо витрин магазинов Instagram позволяет бизнесу арендовать себе живых людей: известных и малоизвестных спортсменов, актеров кино, людей с генетикой и внешностью лучше, чем 99,98% населения планеты. Инфлюенсеров, которые успевают сделать 365 самых лучших фотографий во время курса нестероидных сармсов и тренболоновых сэндвичей, а потом постить эти фото годами, создавая впечатление ожившей античной скульптуры 24/7/365. Людей, которые в полной мере освоили встроенные фильтры Instagram для редактирования изображений и видео: в соцсетях любого человека можно сделать стройнее за 30 секунд, кубики пресса через две недели is so old school. На таких витринах можно продавать что угодно: от пищевых добавок и массажных пистолетов, до эффективных фитнес-приложений и рабочих диет. Вся суть Insta-фитнеса в одном абзаце, не благодарите.

Важно: хоть и с опозданием, но соцсети учатся на своих ошибках. Растущий массив критики несовершенства модерации в Фейсбук подтолкнул соцсети к современным решениям. Инстаграм добавил в личные сообщения фильтры для блокировки хейт спич, троллей, сталкеров, абьюзеров. Фильтр умеет блокировать спамные и оскорбительные слова, эмоджи, умышленные опечатки для обхода фильтра. Кроме того, Инстаграм усложнит жизнь заблокированным аккаунтам — теперь обидчикам одного и того же пользователя будет сложнее регистрировать новую учетную запись после блокировки старого аккаунта. Случилось это в феврале-марте 2021 года и, вероятно, мы и дальше увидим, как соцсети отказываются от модераторов в пользу ИИ-фильтров на стороне клиента.

Политика модерации Instagram запрещает оскорблять и дискредитировать людей на основе расовых, этнических, гендерных отличий, сексуальной ориентации, религиозных и национальных признаков. Запрещена критика частных лиц, хейт на основе недееспособности или болезни.

Однако, если оскорбления и критику подавать как «образовательный контент» или «свободу слова», «личное мнение», то Instagram разрешает нападать на частное лицо и критиковать его от чистого сердца. Топорная работа, но главная метрика соблюдена — вовлечение по касательной задело даже самых стойких и аполитичных людей. Instagram пропускает и не такой контент.

Поэтому креаторам и рекламодателям в Instagram нужно каждый час задавать себе всего один вопрос: «заставляет ли мой контент людей плакать, кричать, мечтать, радоваться, угрожать, расчеловечивать, провоцировать плохо осознанную тревогу от завышенных ожиданий и некорректных сравнений? Мой прямой конкурент — контент в телевизоре. Заставляет ли мой контент людей бросить просмотр ТВ каналов и скролить ленту Instagram?» Если ответ на такой вопрос отрицательный, то такой контент не подходит для Instagram, переходите на следующую итерацию креатива.

Промежуточный вывод по модерации контента в Facebook/Instagram

Дистрибуция контента в Facebook благосклонна к вовлечению и реакциям: алгоритмы соцсети рекомендуют посты, которые вызывают у пользователей однозначную реакцию. Восторг. Страх. Тревог. Возмущение.

Чтобы понять, как вовлечение сказывается на людях, Facebook тестирует свой контент на ничего не подозревающих пользователях. В лучших традициях передовых докторов своего времени, Томаса Паррана и Джона Катлера, Facebook проводит клинические тесты на живых людях. В 2012 году Facebook целую неделю подвергал тестовый сегмент аудитории “эмоциональному инфицированию” — повышенному количеству негативного и шокирующего контента.

Буквально: Facebook семь дней запугивал 689 тысяч пользователей, чтобы измерить эффекты такого алгоритмического нагнетания тревожности in vivo, провоцирования стресса в условиях обычной жизни. Как и в случаях с экспериментами в Гватемале и в Таскиги, научные изыскания Facebook прекратились только под давлением возмущенной прессы и правозащитных организаций.

Сложно утверждать, что подобные исследования прекратились. Может быть Facebook научился аутсорсить их более умелым подрядчикам, кто знает. Но характерная черта этой соцсети — устойчивый интерес к вовлечению раздраженных пользователей — остается неизменной.

***

Часть 2, в которой мы познакомимся с модерацией контента в Twitter.

Модерация контента в Twitter

Иллюзия свободы будет продолжаться до тех пор, пока выгодно поддерживать эту иллюзию. Когда поддержка иллюзии становится слишком дорогостоящей, они разберут сцену, унесут столы и стулья, поднимут занавес, и вы увидите кирпичную стену в конце театрального зала.

Фрэнк Заппа

Дисклеймер: следующий текст может содержать упоминания политики, насилия, расизма. SocialJet решительно осуждает любые проявления жестокости, а нижеследующие примеры служат иллюстрацией качества и скорости модерирования контента в Twitter.

В своих правилах Twitter прямо запрещает контент с изображением жестокости по отношению к людям и животным, расистский контент, изображения и видео обнаженного тела.

Но этот контент разрешено постить в Twitter, если пометить этот тип контента, как образовательный или документальный. Главный критерий контента в Twitter допустимости вам уже знаком: вовлечение. Если ваш контент вовлекает, то правила уже не выглядят такими строгими.

Сомалийские исламисты из Аш-Шабаб впервые вышли на просторы Twitter в 2011 году. Именно в этой соцсети радикальные исламистские группировки с 2012 года регулярно вербуют новых искателей приключений. Повстанцы и террористы в Ираке, Сирии, Афганистане, по всему Сахелю взяли на вооружение лучшие практики Голливуда и стрелялок от первого лица.

На автомат подвешивали камеру GoPro, записывали видеостримы с перестрелок, монтаж видео аутсорсили профессионалам с Final Cut Pro. Для координации маркетинга в Twitter создавались медиа штабы вроде Al Hayat Media Center. Продавался тематический мерч, рисовалась анимация, собирались донаты: революции научились монетизировать свои франшизы, как и любой другой бизнес.

В 2013 году это казалось чем-то запредельно невероятным: при желании, можно было отвлечься от своих таблиц Excel на прямую трансляцию, где бородатые инфлюенсеры кричали в камеру «illa tahin!». В прямом эфире людей подстреливали снайперы, подрывали смертники, бомбила авиация. Авторы документальных видео зачитывали религиозные скрипты перед обезглавливанием своих жертв. Постоянные обитатели Twitter могут помнить эти документалки из серии The Clanging of the Swords.

Прошло пару лет и террористы начали вести свои Twitter аккаунты, как настоящие представители диджитал бизнеса. Аудитория подогревалась, воронки строились, подключались команды аутрича, запускались рассылки, анонсировались видеостримы, накручивались просмотры для попадания в тренды и рекомендации.

Аккаунты ИГИЛ велись на разных языках, таргетировали разные аудитории, использовали большое количество хештегов. Конкуренция среди криминала, особенно среди радикальных группировок Ближнего Востока и западной Африки, зашкаливает — поэтому они первыми используют все новинки маркетинга в Интернете.

В 2013 году Twitter-аккаунты, связанные с ИГИЛ (запрещена в России), фолловили целые редакции мировых СМИ, простые люди, независимые журналисты, представители спецслужб и правительственных организаций. Twitter понял, что терроризм генерирует вовлечение даже среди профессионалов: журналисты, разведчики и специалисты по Ближнему Востоку переписывались в личке с террористами, чтобы лучше понять их мотивы.

Для вовлечения подростков и молодых людей рисовались тематические мемы:

Толстая пародия на гедонистическую мантру YOLO (you only live once)

Стилизация под известную видеоигру

Модераторам Twitter понадобилось три года, чтобы научиться блокировать аккаунты террористов. Аккаунты, которые с первых дней публиковали кадры обезглавливаний и публичными казней военнопленных, боестолкновений в городе и авиаударов по мирным жителям. С 2015 года пошли массовые баны, удаления связанных с ИГИЛ аккаунтов, по 130-360 тысяч аккаунтов ежегодно. Однако, примерно четверть аккаунтов террористов остается в эфире до сих пор — американские спецслужбы объясняют это тем, что такие аккаунты нужны для практического обучения внешней разведки, для идентификации преступников.

Террористов модерировали в Twitter нехотя, всячески оттягивая время. Потому, что такой контент идеален: вовлечение топовое, риски нулевые. Отличное сочетание для платежеспособных аудиторий США и Западной Европы.

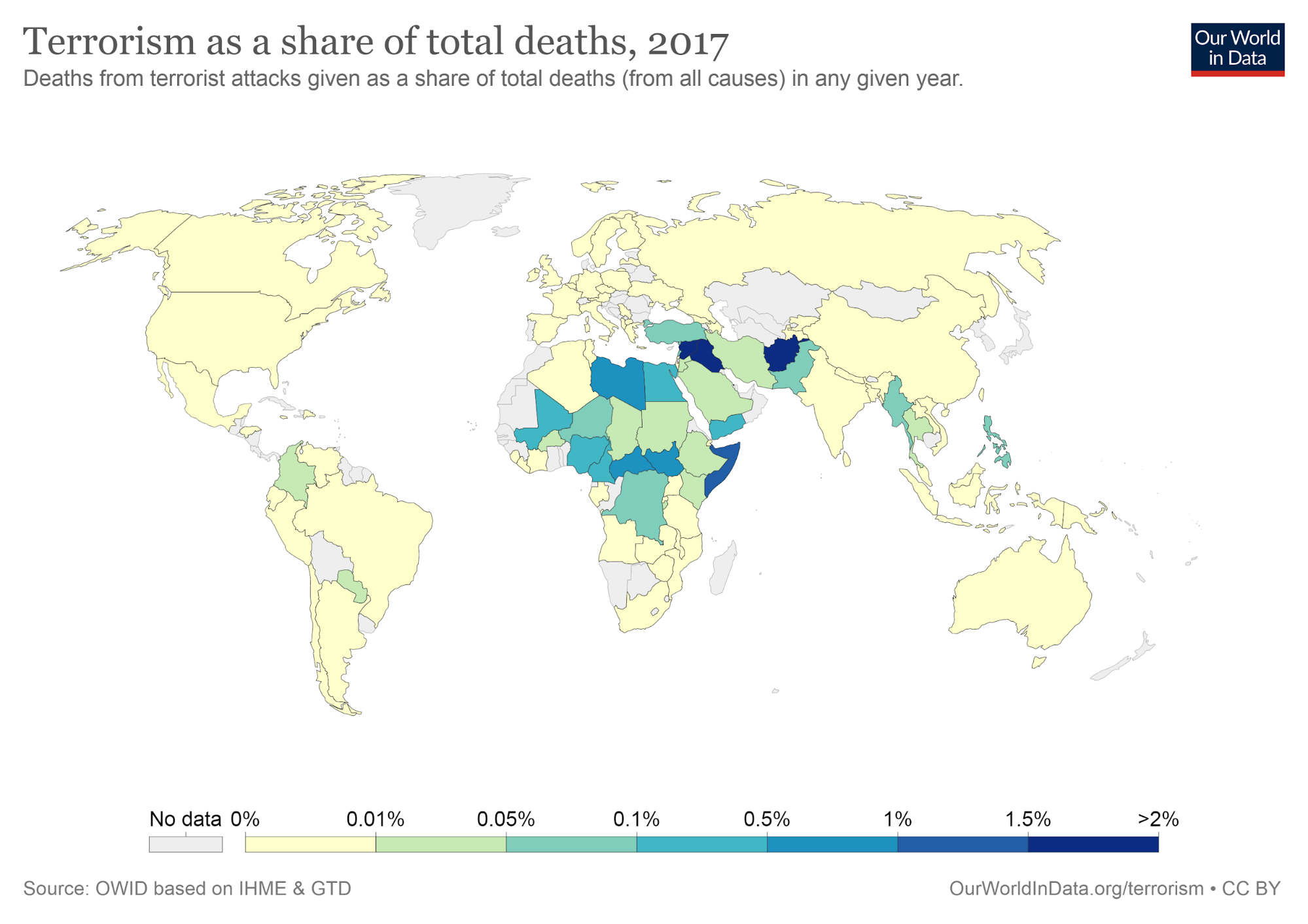

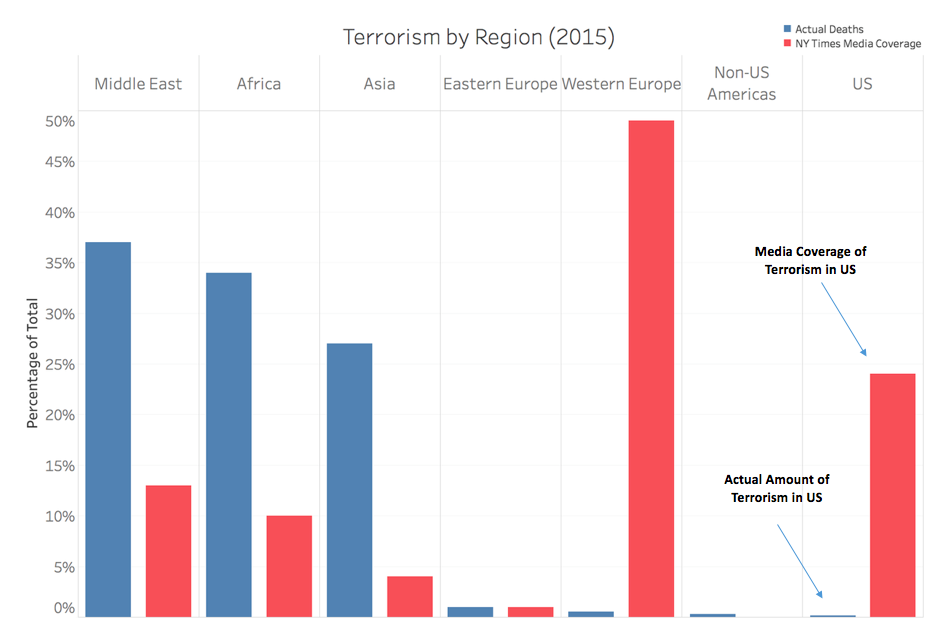

Данные за 2015-2017 года: 95% всех террористических атак случаются на Ближнем Востоке, в Северной и Западной Африке. В Европе и Северной Америке доля смертей от терроризма составляла менее 0,01% от общего количества смертей в год. Что не мешает половине жителей США бояться стать жертвами террористов, потому что так сказали в Twitter, а СМИ подтверждают все, что публикуется в этой соцсети:

Сравнительная таблица за 2015 год: террористы совершают атаки в странах Африки, Ближнего Востока (голубые столбцы), но рассказывают о террористах непропорционально больше в США и Европе (розовые столбцы). Кажется, кто-то нашел способ монетизировать видео нападений террористов и блокировка ИГИЛ-аккаунтов может подождать.

На родине Twitter модераторам понадобилось девять лет для блокировки антифа-аккаунтов на территории США. Радикальные левые группировки отработали свои задачи летом 2020 года. Но даже в январе 2021 года антифа думали, что эта музыка будет вечной и вышли на свою обычную рабочую смену. Как и всегда, антифа после утренней чашки кофе стали громить витрины магазинов, жечь флаги, искать воображаемых врагов на улице. Но утро не задалось…

Левые радикалы выпали из актуальной повестки.

На следующий день после инаугурации, 22 января, Twitter мягко напомнил антифа, что они уже нерелевантны — Байден взял президентство, можно прекращать охоту на ведьм.

Даже в штабе BLM стали подозревать что-то неладное…

Важно: не стоит обольщаться охватами в Twitter. Когда соцсеть поощряет ваш контент, она делает это не потому, что он хорош. Просто соцсеть научилась зарабатывать на вашем контенте, который генерирует вовлечение пользователей. Векторы желаний, интересов, целей Twitter и вашего контента случайно пересеклись, временно совпали. Ничего личного.

Как видим, модерация контента в соцсети непредсказуема и осуществляется техподдержкой Twitter в исключительных случаях. Политика модерации этой соцсети настолько непрозрачна, что Twitter не может объяснить ее даже сенаторам США. #itscomplicated

В помощь сенаторам: политику модерации Twitter можно вместить в одно правило — «Максимин Фракиец раскроет любой заговор, истинный или мнимый».

Модерация Twitter несовершенна до абсурда: соцсеть может годами пропускать контент, который противоречит ее правилам, чтобы неожиданно в один день удалить тысячи аккаунтов. Такие спорадические чистки Twitter проводит несколько раз в год. В январе 2021 соцсеть удалила 70 000 аккаунтов связанных с правой организацией QAnon. В феврале-марте 2021 года зачистили еще несколько тысяч аккаунтов, которые постили непонятные Twitter мемы. Ранее в 2020 году Twitter уже делал похожие операции по массовому удалению аккаунтов альт-райтов. Соцсеть одинаково успешно удаляет левые и правые аккаунты — идеологическая честность модераторов Twitter проявляется даже лучше правил модерации.

Ярким примером непредсказуемости модерации в соцсетях служит занимательный пандемониум новых жертв Twitter: с начала 2021 года широкими жестами справедливости соцсеть банила иностранных троллей; Дональда Трампа; казахстанскую библиотеку научных исследований Sci-Hub; модераторов 4Chan; Комитет Олимпийских игр 2020 в Японии; американскую компанию производителя подушек My Pillow; Чикагский музыкальный театр; несколько десятков аккаунтов, которые упомянули слово «Memphis» хотя бы одном твите; маркетологов Amazon, которые прикрываясь дипфейками пытались сбить волну активности в организации профсоюзов внутри Amazon.

Как и все хорошее, непредсказуемая модерация в Twitter доживает последние дни. С 25 января 2021 года Twitter открыл программу добровольного модерирования Birdwatch. Значит ли это, что еще 24 января модерация контента в Twitter осуществлялась профессионалами и эти профессионалы не справились с оказанным им доверием? Или модерации не было, а была чистка подозрительных аккаунтов в ручном режиме индусским сисадмином за $12.50 в час? На такие вопросы Twitter традиционно отвечает молчанием. Поэтому, чтобы избежать неприятных вопросов от сенаторов, команда Twitter решила отдать модерацию в руки резидентов США, которые не были замечены в нарушении правил соцсети.

Модераторы смотрят на ваш аккаунт в предчувствии хорошего вечера

Ну а пока рядовые твиторчане не ощущают на себе внимательного взгляда праведных блюстителей сетевого порядка, им остаются доступны простые народные забавы, которые с одинаковым жаром разделяют анонимы в Twitter, кинозвезды и редакции СМИ. Называются эти игры «что сегодня сказала Джоан Роулинг?» Благодарные читатели Джоан Роулинг фолловят ее, чтобы найти повод оскорбиться и начать травлю. Самому популярному автору последних лет кибер-травля ничем не угрожает, только портит настроение и дает возможность поупражняться в едких ответах.

Но когда благодарные читатели понимают ничтожность своих нападок на Роулинг, они публикуют похоронки о ее кончине. Так модераторы Twitter самоутверждаются в символической победе над идеологическим врагом, который озвучивает свои политические убеждения или недостаточно хорошо разбирается в интерсекциональной повестке дня.

Twitter с удовольствием включается в игру #RIPJKRowling: травля такого автора генерирует стабильный трафик, риски нулевые, вовлеченность выше среднего. Twitter никогда не заблокирует аккаунт Джоан Роулинг: травля такого человека приносит прибыль Twitter, журналистам, СМИ, всем и относительно безопасна. Си Цзиньпина, арабских принцев почему-то не спешат травить в соцсетях, хотя они более известны и противоречивы, чем Джоан Роулинг.

С похоронами карьеры Джины Карано модераторы Twitter справились за полгода. Начиная с лета 2020 года актриса франшизы «Звездных Войн» трижды посмела высказать свое мнение в соцсети: отказалась поддерживать трансгендерных людей в своей подписи в Twitter, усомнилась в результате выборов в США, сомневалась в необходимости носить маску. Как в бейсболе, три промаха и прощай. В феврале 2021 года Джина Карано попыталась защититься от нападок в Twitter, чем только подлила масла в огонь. Хештег #FireGinaCarano заставил работодателя Карано киностудию Disney извиниться перед модераторами Twitter за высказывания своей актрисы, которую уволили и поставили в черный список.

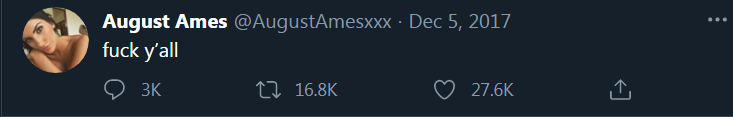

Простым людям везет меньше, чем известным писателям и актрисам. Всего 24 часа понадобилось блюстителям пансексуализма в Twitter, чтобы довести до суицида ментально нестабильную порно-актрису August Ames. Причина: модераторам не понравилось то, как она использовала популярный слоган «моё тело — моё дело» и они наказали выскочку за попытку проявить свободу воли.

Пожелания модераторов были прогрессивными: дерзкой порно-актрисе предложили убить себя. Что она и сделала.

Последний твит жертвы за пару часов до смерти. #fuckyall

Новые правила модерации контента в рунете не позволяют нам объяснить все слои символизма в этой горькой шутке, в последней попытке отбиться от толпы twitter-воинов. Блюстителей пансексуализма Twitter не наказал за доведение до самоубийства, для них ситуация обошлась без бана. Вовлечения было много, СМИ целую неделю перепечатывали подробности травли, — за такое не банят в Twitter.

Совет для креаторов и маркетологов: переход на личности, политика, травля известных людей — самые прибыльные и низкозатратные виды контента в Twitter. Сара Чон (Sarah Joeng) на этом карьеру сделала. Издания The Verge, Motherboard, New York Times с удовольствием нанимают людей, которые могут производить токсичный контент, разжигать ненависть, призывать к расправе над белыми людьми. Ищите таких людей — они дают большие охваты.

А проверять успешных Twitter-журналистов можно на симуляторе Twitter-инфлюенсеров, который показывает, сколько подписчиков можно набрать, если у игрока есть стратегия и он ее придерживается. На грубом примере показана логика реакций пользователей и алгоритмов.

Промежуточный вывод по модерации в Twitter

- всегда регистрируйтесь в Twitter под своим реальными именем, указывайте место работы, тегайте друзей, заливайте видео своих военных трофеев. Twitter желает знать вас в лицо, за это он прощает многое

- учитесь монетизировать раздраженных анонимов или хотя бы получайте бесплатную рекламу на волне негодования

- модерации в Twitter нет, прямо сейчас эта соцсеть учится играть по правилам и готова идти навстречу требованиям правительств. А пока вместо модераторов эта соцсеть может предложить толпы оскорбленных жертв и праведников, которые точно знают, кто нарушил правила и как его наказать

***

Часть третья, в которой мы поговорим о модерации в альтернативных соцсетях.

Модерация контента в альтернативах: Parler и Mastodon

Новые соцсети конкурируют с Facebook, Twitter, Google. Большая тройка (Google, Amazon, Apple) и Microsoft защищают свои доминирующие позиции отключением конкурентов от своих облачных серверов, запретом на подключение платежных систем.

Противостояние лидеров и новичков обострилось после штурма Капитолия в январе 2021 года. Тогда в Кремниевой долине главными виновниками штурма назначили соцсети Gab и Parler, хотя организация протестов проходила в закрытых группах Facebook, там до сих пор можно купить футболки трампистов. На фоне обвинений и отключений молодые соцсети Gab и Parler открыли свои объятия всем недовольным цензурой, принимают по десять тысяч новых пользователей каждый час, а Telegram в январе 2021 пережил вторую молодость и пополнился свежей кровью (+ несколько миллионов новых пользователей в сутки).

Parler использует минимальную выборочную модерацию: из общего пула в примерно 2000 добровольцев выбранные случайным образом 5 модераторов проверяют контент определенного типа. Автоматически блокируется только порно, остальной контент модерируется вручную. Для небольшой соцсети такая модерация не является чем-то необычным: первоочередной задачей новичка на рынке всегда будет набор новых пользователей.

Создатели Mastodon модерируют всего три вида контента на уровне соцсети: расистский, экстремистский, трансфобный. Широкие правила модерации оставляют свободу выбора за администраторами сообществ и пользователями.

Mastodon поощряет локальную и удаленную модерацию: сообщества в этой соцсети находятся на разных серверах и называются instances. Такая кластеризация позволяет строить устойчивые сообщества, защищаться от массовых атак вроде нашествия неонаци из соцсети Gab. Администраторы разных сообществ могут обмениваться опытом, защищать права своих пользователей, предупреждать друг друга и вырабатывать совместные правила реагирования на нетипичные случаи.

Mastodon позволяет админам самим решать, каким правилам следовать на их сервере и с кем они будут общаться в своих сообществах. Аккаунт может уйти в бан на одном сообществе и продолжить общение на всех остальных серверах, правила которых не настолько строги. Или создать свой сервер со своими правилами. Блокировку и удаление аккаунта Mastodon на отдельном сервере можно оспорить через 30 дней — это критическая мера для повторяющихся нарушений.

Администраторы Mastodon могут применять фильтрацию по ключевым словам в описании аккаунтов, изменять неадекватные правилам аватары пользователей. На стороне клиента есть возможности:

- ставить NSFW-плашки на свой контент

- фильтровать контент и аккаунты в ленте по отдельным символами и целым словам

- временно скрывать посты отдельного пользователя в своей ленте, что никак не отражается на активности этого пользователя в лентах других людей

- блокировать, скрывать в ленте отдельные сообщества и целые сервера

Политика модерации в Mastodon благосклонна к обычным людям, но враждебна к спаму. Самореклама, пиар своего бизнеса не поощряются и могут быть наказаны предупреждениями.

Промежуточный вывод по модерации контента в альтернативных соцсетях

- Mastodon показывает то, что Twitter и Facebook обещали десять лет назад — прозрачный свод правил, разумный баланс между свободой слова и защитой от деструктивных тенденций внутри соцсети.

- Parler сейчас переживает детские проблемы развития — для этой соцсети идеологическое противостояние с лидерами рынка сегодня важнее модерации контента.

***

В следующей части узнаем о том, кто и как модерирует OK, VK, Telegram.

Модерация контента в Telegram, OK и VK

Особенности национальной модерации

Правила пользования Одноклассников и Вконтакте запрещают постить чужой авторский контент, защищают интеллектуальную собственность, персональные данные пользователей. Но если сильно хочется, то можно слушать музыку бесплатно, пробивать личные данные любого зарегистрированного человека и продавать их на черном рынке. Если держаться подальше от таких тем, как религия, политика, унижение негроидной расы, оправдание нацистской и экстремистской идеологии, прогулки на свежем воздухе в определенные дни года, то можно обойтись без бана.

Как и в других соцсетях, противоречивый контент разрешено публиковать в Одноклассниках, во Вконтакте с правильными формулировками, — «образовательный», «порицающий». Это простое правило понимают SMM-щики Ижевской епархии, когда на Рождество демонстрировали в соцсетях фотографии циркового номера, где дрессировщики в советской военной форме побеждали животных, «несущих на себе нацистскую символику». Цирковое искусство и соцсети созданы для зрелищ, какие-то правила модерации не могут остановить тягу зрителей к прекрасному.

Модерация контента в OK/VK этот суслик рунета — ее не видно, но она есть. Как и везде: чтобы попасть в бан, стоит на время забыть о золотом правиле всех соцсетей «Или ты генерируешь вовлеченность (даешь народу зрелища), или мы загоним тебя в пессимизацию охватов. Бан для самых непонятливых».

Лирическое отступление.

Большинство соцсетей, поисковиков и мессенджеров умеют применять теневые блокировки. Мягкий бан. Пользователь видит свой пост или рекламу, но его подписчикам заблокированный контент не виден. Instagram, Reddit, Twitter, WeChat, Craigslist были замечены в теневых блокировках и пессимизации показов разного контента без оповещений о бане. Недавно Facebook добавил возможность теневого бана на стороне клиента — пользователи сами могут отключать комментарии к своим постам со стороны определенных аккаунтов.

Не гнушается теневой блокировкой и Yandex — этот поисковик умеет использовать теневой бан, о чем пользователи узнают только после обращения в службу поддержки.

Цитата (орфография автора сохранена):

«Таким образом, при формировании, что ленты новостного агрегатора, что ленты платформы ЯДзен, — достаточно научить алгоритм «правильно» расставлять приоритеты, и одни новости и публикации поднимутся в топ, а другие уйдут за границу видимости для большинства пользователей.

Но ведь для этого надо уметь «правильно учить» алгоритм, а это совсем не просто. Тут набором ключевых слов не обойтись.

Слава богу, есть куда более продвинутые методики машинного обучения, обеспечивающие развитый функционал для любого «цифрового министерства пропаганды». Будь то настоящее министерство или мега-корпорация, — всё одно.

Остается не отвеченным лишь один вопрос – за что же дискриминируется именно канал «Малоизвестное интересное»? Чем он не угодил алгоритму ЯДзена?

Полагаю, ответ лежит на поверхности. И «мотивация алгоритма» ЯДзена та же, что и «мотивация алгоритма» поиска в кейсе Яндекса с Роскомнадзором — нужно продвигать своих. Тех, кто, как пишет ТАСС, «входит в цифровую экосистему Яндекса».

Сергей Карелов

Конец лирического отступления.

В Одноклассниках и во Вконтакте непонятливых пользователей банят редко. Техподдержка внимательно выслушает все жалобы, но сверхурочно не работает, надбавок за интенсивность труда не получает. Поэтому техподдержка Вконтакте аутсорсит часть воспитательной работы специально обученным людям, у которых прайс наказаний за контент не отличается вариативностью — только ст. 148, 280 и 282 УК на все случаи жизни.

Неправильные пост, комментарий, лайк награждаются или штрафом до 500 тысяч рублей, или сроком лишения свободы до 5 лет. На практике штраф и сроки обычно меньше: 1-15 тысяч рублей и 1-2 года соответственно, оправдательные приговоры возможны.

В 2020 году внештатная команда модераторов разнообразила свой прайс и теперь модерация для соцсетей стала жестче, чем для физических лиц. С 10 января 2021 года соцсети обязаны удалять мат в течение суток. Штрафы за невыполнения для соцсетей могут составить от 800 тыс. до 4 млн. рублей за один мат. Как обычно, в рунете такие ограничение к исполнению необязательны: они просто расширяют возможности команды модераторов, мягко склоняя пользователей к самоцензуре.

Чтобы отвлечь пользователей от опасных тем, соцсети обновляют свои продуктовые линейки не только штрафами, но и мобильными играми. Пряник лучше кнута, подумали разработчики Одноклассников и решили поднимать вовлечение экстенсивным способом. Да так, чтобы у пользователей не оставалось времени на мат или политику.

В 2020 году соцсеть прибавила сразу по всем фронтам: +24% дневной аудитории мобильных игр, +18% подарков за один 2020 год. Запуск свежих продуктов и оптимизация экосистемы Одноклассников привели к появлению внутрисетевых расширений: Доктис, Окно, Моменты, Робби, подключение AliExpress, интеграция мини-приложений. Горшочек, не вари.

Модерация контента в Telegram

Никто не знает точное число команды модераторов мессенджера. Пока только редкие каналы проходят проверку в ручном режиме. Блокируют каналы нечасто, по жалобе; обычно за экстремизм, за детское порно в публичных каналах. Администраторы каналов имеют возможность банить подписчиков в чатах: модерация локального уровня.

По сравнению с Twitter телеграм-каналы исламских радикалов удаляются быстро, решительно. Остальные серые и полулегальные сферы (инфобизнес, букмекерство, крипта, сливы/пробивы, договорные матчи и ставки) мирно сосуществуют с полностью белыми каналами.

Администраторам каналов доступны бесплатные и платные боты для постинга в каналах, боты для модерирования чатов (chatkeeper, angrymoderbot, shieldy). Боты могут похвастать несложными фильтрами по ключевым словам, триггерам, стоп-словам, простыми решениями по автоматизации отправки предупреждений и сбору аналитики.

Техподдержка Telegram живо реагирует на жалобы и подозрительную активность — если новый канал резко прибавляет по несколько десятков тысяч подписчиков в сутки, то на него могут повесить плашку [SCAM] до выяснения подробностей.

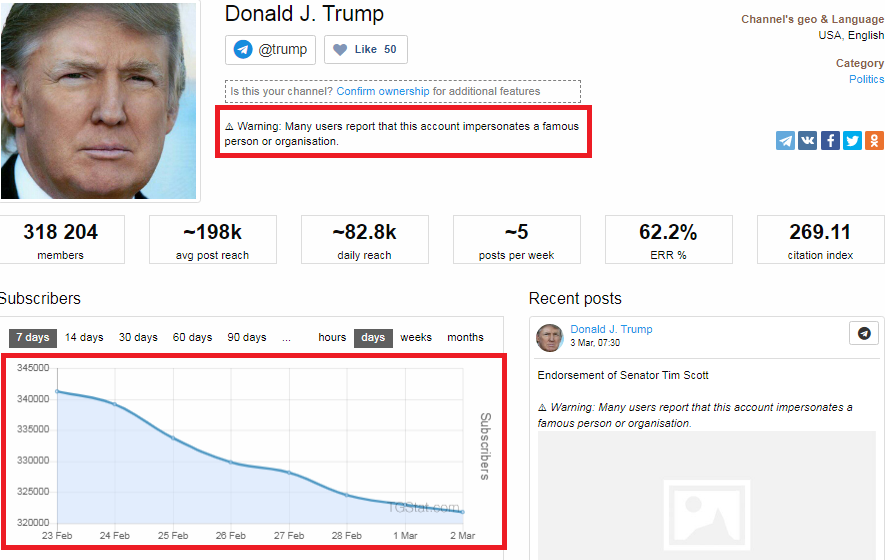

Подозрительный канал имени Дональда Трампа резко набрал популярность. Но его проверили и осадили.

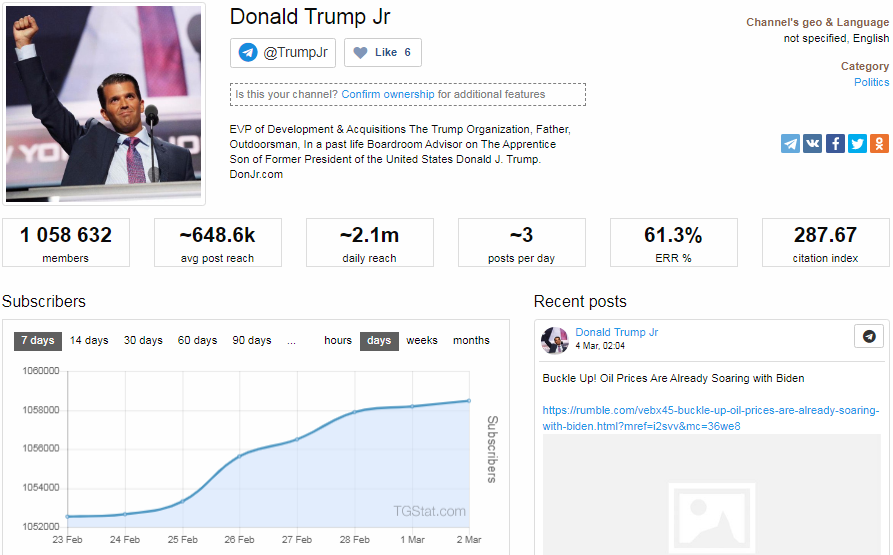

А вот telegram-канал Трампа-мл. живет и здравствует, близится к миллиону подписчиков.

Промежуточный вывод по модерации контента в Telegram, OK, VK.

- Как и в случае с заокеанскими соцсетями, в российских аналогах модерация контента непрозрачна, случайна, работает через раз.

- Владельцев Одноклассники и Вконтакте сегодня больше заботит монетизация и поиск возможностей остаться на плаву. Поэтому они аутсорсят модерацию контента специально обученным людям в погонах, пока сами лихорадочно ищут способы повысить вовлечение своих пользователей.

- Telegram стоит особняком ввиду своей относительной независимости от регулирующих органов. Но слабая модерация в мессенджере позволяет злоумышленникам угонять каналы, нагонять ботов, регистрировать популярные telegram-каналы на чужое имя, сливать и пробивать личные данные пользователей. В отдельных чатах модерация на высоте, но это уже личная заслуга администраторов, которые умеют пользоваться готовыми инструментами и головой.

***

Глобальный вывод по модерации в соцсетях

Обычно соцсети смещают бремя ответственности за модерацию контента на своих пользователей, а правила модерации прописаны таким образом, что их можно трактовать широко. И даже шире, чем вы себе можете представить.

Признание проблемы затянулось: большинству соцсетей понадобилось 8-12 лет, чтобы опубликовать пресс-релиз, в котором они соглашаются, что им нужно поработать над модерацией. 8 февраля 2021 года соцсети решили более строго проверять UGC контент в своих лентах.

Заслуженно получив тонны негатива за теневые блокировки и несовершенную модерацию, соцсети встали на путь исправления только после регулярных бесед в сенате США.

Представители Twitter, Facebook, Google подтвердили свое намерение оказывать поддержку в борьбе с экстремизмом, теориями заговора и фейковыми новостями на своих платформах. Речь идет о Законе о Порядочной Коммуникации (раздел 230), который сенаторы США призвали изменить в сторону увеличения ответственности соцсетей и технологических компаний за контент, который появляется на их платформах. Во Франции, России, Австралии правительства решили применять похожие законодательные акты в отношении соцсетей.

В общих чертах обе стороны (технокомпании+соцсети vs. правительства) соглашаются, что модерацию контента в Интернете нужно сделать строже и прозрачнее. В данный момент между правительствами и соцсетями идут многоуровневые торги за степень прозрачности алгоритмов дистрибуции контента, за глубину таргетинга рекламой в соцсетях.

Наблюдая за выработкой новой ответственности за модерацию контента, новые соцсети вынуждены публиковать правила модерации, объяснения к правилам модерации, интерпретации объяснений правил модерации.

Получив недвусмысленное предупреждение от общества, соцсети взялись за модерацию контента не с той стороны. Не только люди-модераторы решают, что показывать в лентах — алгоритмы соцсетей определяют видимость и скорость распространения контента. И эти алгоритмы любят определенные виды контента в соцсетях: фейковые новости получают больше внимания и распространяются быстрее и шире, чем истинные репортажи.

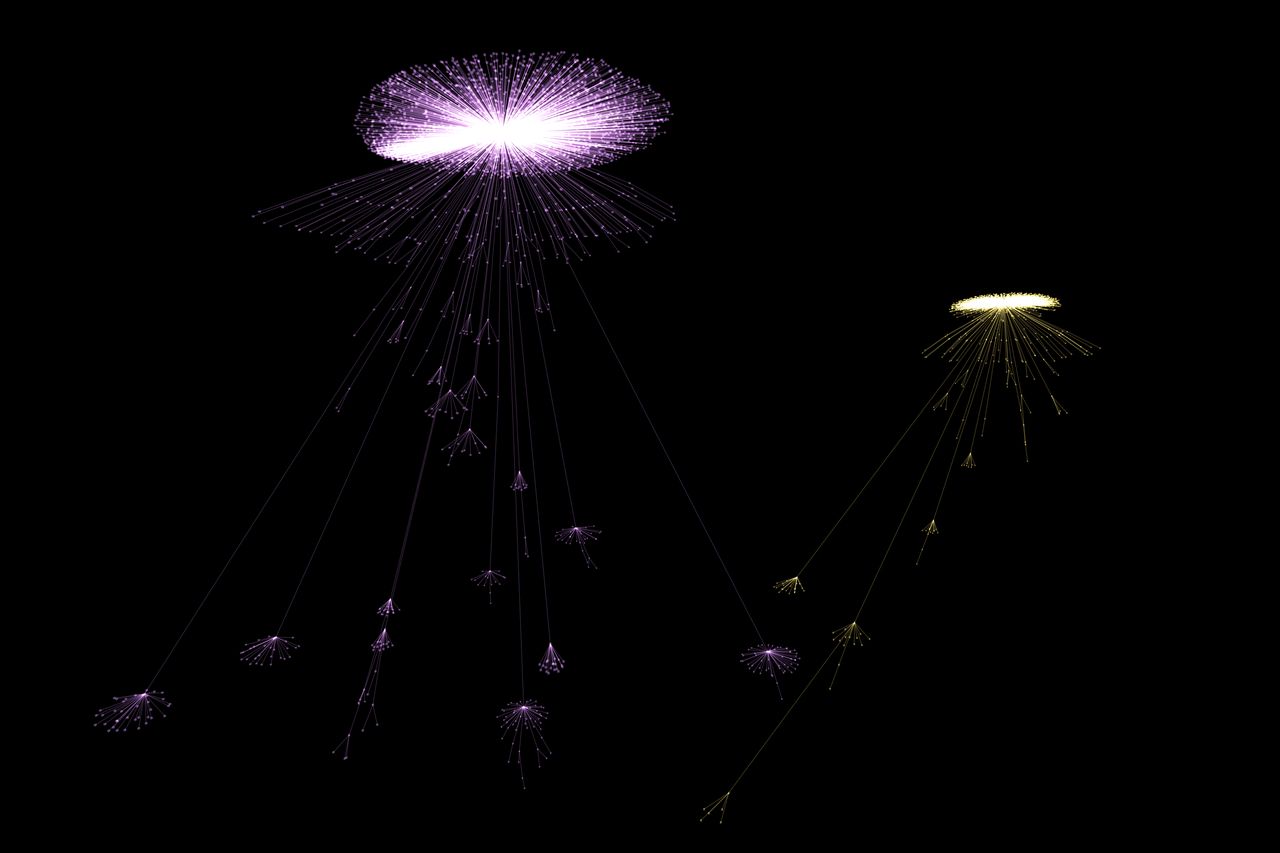

Фейковые новости (фиолетовая медуза), истинные репортажи (золотистая медуза). Источник

Именно такое неконтролируемое людьми появление в социальных медиа инфокаскадов заставляет нервничать правительства, вводить новые требования к модерации платформ и UGC контента. Правительства закономерно не любят бесконтрольные эмоциональные заражения (геймергейт, шведские активистки-восьмиклассницы, интервью Меган Маркл), финансовые заражения (декабрьский скачок BitCoin, февральский демарш GameStop, мартовское помешание на NFT артефактах), которые регулярно происходят в соцсетях.

Несмотря на стремления разработчиков, алгоритмы соцсетей не любят умеренных людей. Бинарная логика алгоритмов не понимает золотую середину, поэтому в соцсетях пользователи с умеренной жизненной позицией рано или поздно становятся экстремистами. Исследование проводилось на пользователях соцсетей в США и показало, что алгоритмы социальных медиа поляризуют людей, их точки зрения и аргументы. Это прекрасно понимают опытные пользователи соцсетей, которые уже делают свои методички для привлечения обычных людей в экстремальные течения разного толка — между правыми и левыми экстремистами на YouTube уже давно идет своя холодная война за внимание зрителей и благосклонность алгоритмов.

Более того, реальные экстремисты используют мемы и SEO-неймдроппинг (подпишитесь на PewDiePie) для того, чтобы алгоритмы соцсетей быстрее подхватывали и распространяли их манифесты — узнав логику социальных алгоритмов, некоторые люди взламывают ее целенаправленно. Именно об этом беспокоятся сенаторы США, когда предлагают Facebook разобраться с модерацией контента. Но Facebook и остальные соцсети делают вид, что не понимают, чего от них хотят — так появляются чисто формальные подрядчики Facebook Oversight Board и Twitter Birdwatch.

Не все так плохо, как может показаться после прочтения данной статьи.

Некоторые соцсети быстрее остальных реагируют на вызовы, оперативнее исправляют недостатки модерации контента.

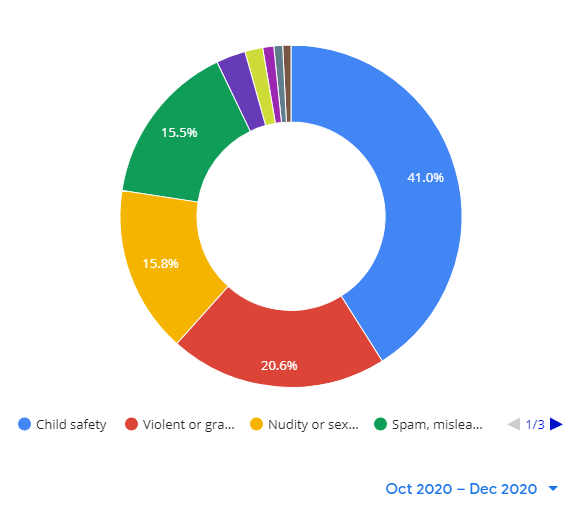

YouTube и Discord регулярно публикуют годовые показатели своих усилий по удалению опасных тенденций со своих площадок. Например, команда YouTube говорит, что с октября по декабрь 2020 год они удалили 2 миллиона каналов, 9 миллионов видео роликов и 900 миллионов комментариев. Более 80% удаленных каналов загружали мошеннические видео или спамили вторичным контентом. Это уже n-й раунд борьбы алгоритмов YouTube с Эльзагейтом (потоком видео, в которых эксплуатируются дети, игрушки) — видеохостинг начал жестче реагировать на детский контент.

Стэнфордская комиссия по соблюдению кибербезопасности в Интернете недавно начала мониторить способы и методы, которыми соцсети, поисковики, гейминговые платформы отслеживают и предупреждают склонность пользователей к самоповреждающему поведению, расстройствам пищевого поведения.

В отчете комиссии представлены 39 соцсетей и других Интернет-площадок: лучше всего замечает аутоагрессивные, деструктивные особенности поведения своих пользователей тройка платформ для креаторов/блогеров (TikTok, Twitch, YouTube). Дейтинговые сервисы и Discord следят за безопасностью своих пользователей, имеют проработанные правила модерация вредоносного/провоцирующего контента — эти платформы получили средние оценки в рейтинге безопасных сервисов.

Поисковики, гейминговые площадки, мессенджеры и некоторые сетевые форумы (Reddit, Telegram, Clubhouse, 4Chan ) хуже остальных платформ работают с проблемным контентом и поведенчески нестабильными пользователями.

***

Как и в реальной жизни, правила пользования соцсетей соблюдают не все.

Победители генерируют вовлечение и гигабайты внимания, получают эксклюзивные права и миллионные просмотры.

Остальные довольствуются правилами и политикой модерации.

Мы все равны, только одни равнее других.

Might is right — у кого больше левериджа в общении с соцсетями, тот и получает больше возможностей.

Чтобы побеждать в соцсетях, нужно думать, как рекомендательные алгоритмы: достоинства и недостатки социальных медиа это не столько заслуга людей-модераторов, сколько особенности поведения алгоритмов дистрибуции контента.

Учитесь генерировать вовлечение, учитесь производить страх и ненависть, конспирологию и фейки в промышленных масштабах, учитесь постить оптимизированный контент с высоким аддиктивным потенциалом: пока не будет радикальной реформы алгоритмов, соцсети любят такой контент и распространяют его несмотря на сверхурочные старания людей-модераторов.

Если вы хотите делать продажи из соцсетей, то вовлекайте и раздражайте, а не соблюдайте правила модерации, которые элементарно обходятся балканскими школьниками.

Мы в платформе дистрибуции контента SocialJet любим и умеем работать с модерацией в соцсетях. Чего и вам желаем.

***

SocialJet — платформа дистрибуции контента. Неутомимый исследователь мира соцсетей.